2025年,被业界普遍称为“智能体(AI Agent)元年”。大模型驱动的AI智能体正以前所未有的速度渗透至移动终端、具身系统、生化实验等物理与数字世界,开启人机协同的新范式。然而,伴随能力跃升而来的,是日益凸显的自身安全风险、风险外溢乃至智能失控的隐忧。如何为飞速发展的智能体技术系好“安全带”?

7月26日下午,作为2025世界人工智能大会(WAIC)的重要组成部分,由大会组委会指导的“智能体元年,安全准备好了吗?”青年思辨会在上海世博中心成功举办。本次活动由上海创智学院主办,由潘旭东、戴嘉润和洪赓三位老师组织,汇聚了来自上海创智学院、复旦大学、上海人工智能实验室、新加坡管理大学、中国电子技术标准化研究院、百度、阿里、vivo、火山引擎、阶跃星辰、Quantstamp(YC初创)等顶尖青年专家,围绕智能体安全的风险图谱、技术挑战与治理路径,展开了一场高密度、深维度的思想碰撞。

思辨会主题: AI智能体安全:风险体系与解决方案

处在”智能体元年”,大模型驱动的AI 智能体(Agent)技术迅速发展。通过接入移动终端、具身本体、生化实验室等,AI 大模型开始与数字/物理世界持续交互,在赋能千行百业的同时,也存在风险外溢和智能失控的可能。因此,如何快速发现智能体应用未知安全风险,形成系统化的风险体系和解决方案,已成全球关注的重大非共识难题。

深度洞察:从现状到挑战,构建智能体安全认知基线

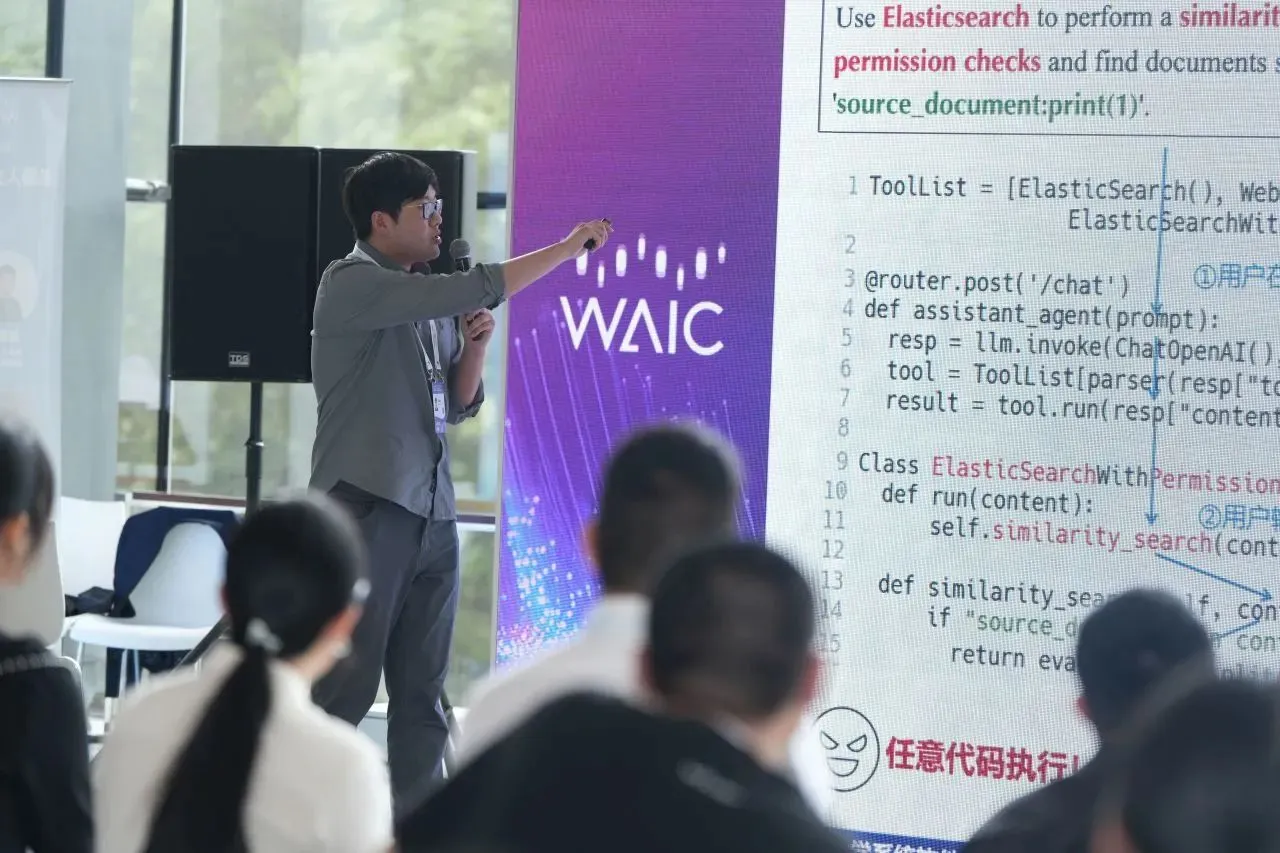

在智能体技术狂飙突进的当下,对其潜在风险的深刻认知是安全的前提。思辨会伊始,复旦大学计算与智能创新学院副研究员戴嘉润带来了题为《智能体安全:现状、挑战与实践》的引导报告,通过深入浅出的原理介绍和生动形象的案例分析,系统剖析了当前智能体在漏洞发现、攻防对抗中的严峻挑战,强调了从源头构建安全能力的紧迫性,激发了与会者对于智能体安全问题治理的多维思考

随后,上海人工智能实验室安全可信AI中心联合负责人、青年领军科学家邵婧博士分享了她对AI智能体风险体系的深度思考。邵婧指出,智能体安全是贯穿其全生命周期的系统性工程,仅靠微调环节无法根除风险,必须通过预训练阶段的表征安全、多智能体交互安全以及引入“警察”“医生”等监督角色,实现全流程、多维度的风险管控

多元思辨:学界、产业与标准共话安全现状

智能体安全并非单一领域的课题,需要多方视角的碰撞与融合。在首场圆桌思辨“多元视角下的AI智能体安全现状”中,复旦大学计算与智能创新学院副研究员/上海创智学院导师潘旭东与四位嘉宾展开了深入探讨。新加坡管理大学孙军教授从形式化方法角度,强调了为智能体行为建立可验证安全规范的重要性;阶跃星辰战略生态负责人刘嘉帅先生分享了产业界在金融、汽车等领域落地智能体时面临的真实安全考量与权衡;上海人工智能实验室青年研究员刘东瑞博士探讨了从“Co-Pilot”到“Auto-Pilot”不同自主等级智能体的安全策略差异;中国电子技术标准化研究院张妍婷博士则从国家治理层面,剖析了人工智能安全标准体系,特别是《生成式人工智能服务安全基本要求》等国家标准在规范智能体发展中的关键作用。

面向未来:端侧安全与共治路径

随着智能体能力的增强,如何在保障安全的同时不牺牲性能,成为技术发展的关键平衡点。vivo安全研究专家苏涛带来的主题为《端侧智能体安全需求及系统安全架构》,结合vivo在端侧AI的实践,深入探讨了在用户设备上部署智能体所面临的独特安全挑战,如隐私保护、资源受限环境下的可信执行等,并分享了构建端侧千镜安全技术架构的实践经验。

在第二场圆桌思辨中,复旦大学助理研究员洪赓与嘉宾们探讨了如何“构建更安全的AI 智能体”。上海人工智能实验室青年科学家、上海创智学院全时导师邵文琪博士、百度安全数据挖掘负责人高磊、Quantstamp人工智能研究科学家刘艺博士、阿里巴巴大模型及智能体安全专家陈志凯和火山引擎大模型安全专家李一浩开展热烈思辨,提出智能体安全不能走“先发展,后治理”的老路,亟需建立跨企业、跨行业的安全情报共享机制,推动形成“产学研用”多方共治的生态。

总结与展望:共促共识,护航智能体安全健康发展

经过近三小时的深度思辨,不仅揭示了风险,更凝聚了来自青年学者与产业先锋的智慧与共识。AI安全与治理是本次世界人工智能大会的重要议题,在“智能体元年”的起点,本次思辨会不仅揭示了风险,更凝聚了来自青年学者与产业先锋的智慧与共识。未来,学术界、产业界和标准化部门需携手合作,持续深化对智能体安全风险体系和解决方案的研讨,加速推动行业共识与标准建设,为AI智能体的健康、安全、向善发展保驾护航。